الديب فيك في 2026: كيف تكتشفها قبل أن تخدعك

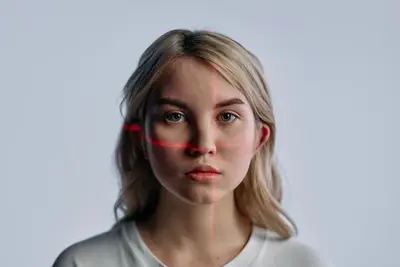

Photo: cottonbro studio

النقاط المغطاة في المقال

في 2020 خسرت شركة إماراتية 35 مليون دولار عبر مدير بنك في هونغ كونغ خُدع بمكالمة مزيفة، وتكشّفت تفاصيل الحادثة في وثائق قضائية أمريكية عام 2021. السبب مكالمة صوتية مزيفة بالذكاء الاصطناعي. الحادثة تحوّلت من خبر غريب إلى سيناريو متكرر يُطارد المستخدم العربي يوميًا. أرقام 2026 تقول إن حوادث الديب فيك في الشرق الأوسط قفزت 643% خلال فترة قصيرة. كما صار 11% من الاحتيال العالمي يعتمد على هذه التقنية وحدها.

في 21 أبريل 2026 أطلقت يوتيوب أداة رصد التشابه (Likeness Detection) لنجوم هوليوود الموقّعين مع وكالات CAA وUTA وWME وUntitled Management. جاء ذلك بعد توسيع سابق شمل السياسيين والصحفيين في مارس 2026. الأداة ممتازة لمن يملك وكيل أعمال. لكنها تترك المستخدم العادي في السعودية ومصر والإمارات بلا أي حماية.

هذا الدليل يقدّم لك الخطة الكاملة لكشف الديب فيك. ستجد خمس أدوات مجانية مع أرقام الدقة الفعلية. وسبع علامات يدوية تعمل خلال عشر ثوانٍ. وخطوات عملية للإبلاغ في السعودية والإمارات ومصر. لا نظريات عامة، بل قرارات سريعة تصلح لمقطع يصلك على واتساب بعد قليل.

أداة يوتيوب الجديدة ضد الديب فيك: ما الذي أُطلق بالضبط ولمَن؟

أعلنت يوتيوب يوم 21 أبريل 2026 توسيع أداة Likeness Detection لتشمل نجوم هوليوود ووكلاءهم. التجربة بدأت في 2025 مع صنّاع المحتوى ضمن برنامج شركاء يوتيوب (YPP). ثم انتقلت في 10 مارس 2026 إلى المسؤولين الحكوميين والصحفيين والمرشحين السياسيين، وفق مدونة يوتيوب الرسمية. الشركاء الرسميون في التوسيع الجديد هم وكالات CAA وUTA وWME وUntitled Management. هذا ما أكّده تقرير TechCrunch.

منطق الأداة قريب من Content ID المستخدم في حقوق النشر. تُحلّل المنصة الفيديوهات المرفوعة بحثًا عن وجه المشترك. فإذا ظهر مقطع مولَّد بالذكاء الاصطناعي يحمل ملامحه، أبلغته الأداة. عندها يختار بين طلب إزالة بموجب سياسات الخصوصية، أو تقديم طلب حقوق نشر، أو تجاهل المقطع. محتوى المحاكاة الساخرة يبقى مسموحًا حسب شروط المنصة.

تُلزم يوتيوب كل مشترك بالتحقق من هويته قبل التسجيل. وتؤكد أن بيانات التحقق تُستخدم لهذه الميزة فقط. ولا تُغذّى إلى نماذج جوجل التوليدية. كشف التلاعب الصوتي لم يصل إلى يوتيوب بعد. أشارت الشركة إلى أنه قادم في تحديثات لاحقة. ولا يزال المستخدم خارج نطاق الأداة ما لم ينتمِ إلى وكالة أعمال أو مجال صحفي/سياسي. ولمقارنة خطوات الخصوصية في منصات أخرى، راجع دليلنا عن خصوصية الذكاء الاصطناعي في 2026.

جدول زمني سريع لأداة يوتيوب

بدأت المسيرة منتصف 2025 بتجربة محدودة لصنّاع المحتوى داخل YPP، ثم توسّعت في 10 مارس 2026 لتشمل المسؤولين الحكوميين والصحفيين والمرشحين السياسيين، وأخيرًا وصلت في 21 أبريل 2026 إلى كل نجم موقّع على عقد مع إحدى الوكالات الأربع. اعترفت يوتيوب في مارس 2026 بأن عدد مقاطع الديب فيك المحذوفة عبر هذه الأداة لا يزال صغيرًا جدًا، من دون إفصاح عن رقم محدد، ما يعني أن الاختبار الحقيقي لمدى فاعليتها أمامنا هذا العام.

الديب فيك وصلت للعرب: الأرقام التي تجعلك هدفًا محتملًا

الصورة الإقليمية أسوأ مما يظنه كثيرون. ترصد تقارير الأمن السيبراني قفزة قدرها 643% في حوادث الديب فيك بالشرق الأوسط. في الوقت نفسه بلغت نسبة الاحتيال المعتمد على هذه التقنية عالميًا 11% من إجمالي عمليات الغش في 2026، وفق Bright Defense. ارتفعت هجمات التصيّد الاحتيالي في الإمارات وحدها بنسبة 21.2% في الربع الثاني من 2025 مقارنة بالربع السابق.

أخطر حادثة موثّقة استهدفت شركة إماراتية مطلع 2020 عبر مدير بنك في هونغ كونغ، قبل أن تتكشّف تفاصيلها في وثائق قضائية أمريكية عام 2021. قلّد محتالون صوت مدير تنفيذي بالذكاء الاصطناعي. واستدرجوا مدير البنك ليحوّل 35 مليون دولار بنداء هاتفي واحد. في 2025 خرج وزير الاقتصاد الإماراتي عبدالله بن طوق المرّي شخصيًا ليحذّر من استخدام صورته في إعلانات استثمار وهمية على منصات التواصل، وفق تقرير AGBI.

على المستوى الشخصي، أبلغ 28% من مستخدمي الإمارات عن تأثير الديب فيك على علاقاتهم الشخصية ومنصاتهم الاجتماعية. وهي من أعلى المعدلات عالميًا بعد ألمانيا (34%). وفي تحذير صريح، نبّه خبراء أمن خليجيون عبر Gulf News إلى موجة من شخصيات افتراضية مولّدة بالذكاء الاصطناعي تنتحل صور مسؤولين لاستدراج المستثمرين.

دراسة ACFE وSAS: 7% فقط جاهزة

كشفت دراسة مشتركة بين ACFE وSAS نشرتها SAS في مارس 2026 أن 77% من خبراء مكافحة الاحتيال رصدوا ارتفاعًا ملحوظًا في هجمات الهندسة الاجتماعية القائمة على الديب فيك. في المقابل 7% فقط من المؤسسات تعتبر نفسها مستعدة لصدّها. ويفرض القانون الإماراتي غرامة لا تقل عن 100 ألف درهم على من يتداول معلومات غير موثّقة قد تشمل الديب فيك، ترتفع إلى 200 ألف درهم في حالات الأزمات والطوارئ، بحسب تقرير Security MEA. الخلاصة: الخطر قريب جدًا، والعقوبة جاهزة، لكن درعك التقني يعتمد أولًا عليك.

أفضل 5 أدوات مجانية لكشف الديب فيك في 2026

جرّبنا عشرات الأدوات فلم تصمد فعلًا سوى خمسة خيارات مجانية تعمل اليوم وتعطي نتائج قابلة للاستخدام. كل اختيار يناسب موقفًا مختلفًا، والقرار يبدأ بمعرفة نوع الملف الذي أمامك: فيديو، صورة، صوت، أم أكثر من نوع دفعة واحدة.

1. Deepware Scanner - الأسهل للمقاطع القصيرة

يعمل عبر المتصفح من scanner.deepware.ai من دون حساب. يقبل الفيديو بصيغ MP4 وAVI وMOV وWMV أو رابطًا من يوتيوب وفيسبوك وتويتر. يحلّل الوجوه بمعدل إطار واحد في الثانية حتى عشر دقائق. دقّته المُعلنة 88% وفق مراجعة Screenapp. ويوصي بدقة 1920×1080 على الأقل. يكتشف استبدال الوجوه فقط ولا يحلّل الصوت. ويناسب تحديدًا فيديو يصلك عبر واتساب ولا تتأكد من هوية الشخص فيه.

2. Intel FakeCatcher - الأعلى دقة حتى الآن

يدّعي Intel FakeCatcher دقة 96%. يعتمد على تحليل مؤشرات تدفق الدم تحت الجلد (PPG) في 32 نقطة بالوجه. ويُشغّل 72 تدفقًا متزامنًا في الفحص الفوري. النسخة الكاملة للمؤسسات فقط. لكن المستخدم العادي يستفيد منها عبر شركاء إنتل في أدوات التحقق من الصور الصحفية. ومن خلال مقاطع الاختبار المنشورة في مختبر أبحاث إنتل للتحقّق من ميزاتها.

3. Deepfakedetection.io - شامل للصور والصوت

خيار نادر يعمل deepfakedetection.io بلا حساب وبلا حد استخدام. يقبل ثلاثة أنواع: صور وفيديوهات وملفات صوت. التقرير يظهر خلال ثوانٍ ويقسّم النسبة بين حقيقي ومزيّف. هذا يجعله أول ما نستخدمه عند فحص مقطع صوتي منسوب لشخصية عامة في السعودية أو مصر.

4. Reality Defender - للفحوصات الدورية عبر API

يتيح Reality Defender واجهة API وSDK مجانيتين تشملان 50 فحصًا شهريًا للصور والصوت. وهي مناسبة للمطوّرين وصنّاع المحتوى الراغبين في دمج الفحص داخل منصاتهم. العلامة التجارية موثوقة لدى صانعي القرار في مجال الاحتيال المالي. لذا، لا يُستهان بمخرجاتها.

5. DFDetect - تخصّص في الصور فقط

إن كانت القضية صورة شخصية واحدة - لقطة مسرّبة من واتساب مثلًا - فإن DFDetect يتصدّر الخيارات. يفحص كل وجه داخل الصورة. ويعطي نسبة واقعية لكل شخص خلال ثوانٍ. بلا تسجيل أو دفع.

مقارنة سريعة بين الأدوات الخمس

| الأداة | الأنواع المدعومة | الدقة المُعلنة | حدود الاستخدام | الأفضل لـ |

|---|---|---|---|---|

| Deepware Scanner | فيديو فقط | 88% | 10 دقائق، دقة 1080p | مقاطع واتساب وتويتر |

| Intel FakeCatcher | فيديو لحظي | 96% | مؤسسات وشركاء | غرف أخبار وقنوات |

| Deepfakedetection.io | صور + فيديو + صوت | غير معلنة | بلا حد ولا تسجيل | المقاطع الصوتية المشبوهة |

| Reality Defender | صور + صوت | مؤسسية | 50 فحص/شهر مجاني | المطوّرين وصنّاع المحتوى |

| DFDetect | صور فقط | غير معلنة | بلا حد | صور مسرّبة على واتساب |

رأينا الواضح: ابدأ بـDeepware للفيديو. وDFDetect للصور. وDeepfakedetection.io للصوت. ثلاثة مواقع إلكترونية تكفي لغطاء شامل خلال أقل من خمس دقائق.

أيهم يناسب موقفك؟

إن كنت صحفيًا في السعودية أو الإمارات تتلقّى فيديوهات يومية لشخصيات عامة، اجعل FakeCatcher عبر شركاء إنتل قاعدتك الأولى. دقّته 96% كفيلة بحماية سمعتك المهنية. أمّا المستخدم العادي الذي يصله مقطع على واتساب من شخص يدّعي أنه قريب في ضائقة، فـDeepware Scanner خياره الأمثل. لا حساب، لا دفع، خمس ثوانٍ ونتيجة. صانع المحتوى الذي ينشر فيديوهات أسبوعية يحتاج إلى Reality Defender عبر API مجاني بـ50 فحصًا شهريًا. يدمج الفحص في سكربت النشر ويوقف أي ديب فيك قبل ظهوره على قناته. الباحث الأكاديمي أو طالب الأمن السيبراني يجمع بين Deepfakedetection.io وDFDetect للحصول على مقارنة بين أكثر من محرّك في تقرير واحد. لا تنسَ أن دمج أداتين يرفع دقة الكشف إلى ما فوق 95% حتى لو كانت كل أداة منفردة أقل.

7 علامات تكشف الديب فيك في 10 ثوانٍ بلا أي أداة

ليست كل المقاطع تستحق رفعها إلى أداة تحليل؛ أحيانًا تُخبرك عيناك قبل أي خوارزمية. بعد مراجعة عيّنات من صور ومقاطع مولّدة نشرتها PetaPixel وEngadget حول قدرات ChatGPT Images 2 ونماذج الديب فيك المنافسة، لاحظنا سبع علامات تتكرر وتمنحك حكمًا أوليًا سريعًا.

العلامة الأولى: الرموش تختفي والرمش يتأخر

نماذج التوليد تواجه صعوبة في محاكاة الرمش البشري الطبيعي. فيظهر الشخص ثابتَ العينين لعشرين ثانية أو يرمش بوتيرة متسارعة. راقب لقطة قريبة واحسب ترددها. أقل من 15 رمشة أو أكثر من 25 في الدقيقة يستدعي الشك.

العلامة الثانية: حدود الوجه تهتز قليلًا

عند تحريك الرأس تُلاحظ اهتزازًا ناعمًا حول الذقن وخط الشعر، كأن قناعًا يطفو فوق الجلد. كبّر الفيديو إلى 200% وشغّله بربع السرعة؛ الحدود المزيفة تفضح نفسها.

العلامة الثالثة: مزامنة الشفاه مختلّة

الصوت يسبق حركة الشفاه أو يتأخر بمقدار جزء من الثانية بشكل متكرر. يحدث ذلك خاصة على الحروف الشفوية مثل (ف، ب، م). خذ ثلاث عيّنات عشوائية من المقطع. تكرار الاختلال علامة قوية.

العلامة الرابعة: انعكاس العين غير واقعي

العين الحقيقية تعكس مصدر الإضاءة بتماثل واضح. في الديب فيك يختلف الانعكاس بين العين اليمنى واليسرى. أو يغيب تمامًا. زوم قوي على قزحية العين يكفي.

العلامة الخامسة: البشرة ناعمة بشكل مريب

الذكاء الاصطناعي التوليدي يميل إلى إزالة المسام الدقيقة والبقع الخفيفة. بشرة بلا أي تفصيل تحت إضاءة عادية؟ احذر.

العلامة السادسة: أطراف الشعر تتكسّر

خصلات الشعر الرفيعة تختفي أو تتحول إلى كتل عند الحركة. راقب الشعر على الجبهة والرقبة تحديدًا.

العلامة السابعة: إضاءة مثالية بشكل غير طبيعي

الديب فيك يبدو كأنه صُوّر في استوديو مغلق مهما ادّعى صاحبه. الظل الطبيعي للأنف على الخد نادرًا ما يُحاكيه النموذج بدقة. كذلك الاختلاف بين شدة الضوء على الجبهة والفك. وقد شرحنا سابقًا تفاصيل أداء هذه النماذج في مقارنتنا بين ChatGPT Images 2 وNano Banana، التي تكشف لماذا بات كشف التزييف أصعب.

اكتشفت ديب فيك؟ خطوات الإبلاغ في السعودية والإمارات ومصر

لا تحذف المقطع قبل توثيقه. أول خطوة هي تصوير الشاشة وحفظ الرابط الأصلي. الإزالة لاحقًا قد تُفقد الدليل. بعد ذلك ينقسم الإبلاغ إلى ثلاثة مسارات: المنصة ذاتها، الجهات الرسمية المحلية، والمحامي حين يتعلّق الأمر بابتزاز أو تشهير.

الإبلاغ داخل المنصات

على يوتيوب استخدم قائمة الإبلاغ > انتحال الشخصية. وعلى تيك توك ارفع طلبًا من Report > Impersonation. وعلى واتساب أرسل الرابط إلى حساب الدعم الرسمي. تيك توك ويوتيوب يقبلان الآن طلبات الإزالة المرتبطة بالديب فيك ضمن سياسات الخصوصية، ويُضاف إلى ذلك أداة Likeness Detection الجديدة. تذكّر أن مراسلة دعم واتساب لا تغني عن التحقّق من الطرف الآخر، وقد ناقشنا ذلك في دليل خصوصية واتساب بعد اتهامات ماسك ودوروف.

الجهات الرسمية الخليجية

في الإمارات يتلقّى موقع eCrime بلاغات الجرائم الإلكترونية. الوصول عبر تطبيق شرطة دبي ومنصة ecrime.ae. يتيح رفع الملفات مع وصف نصّي قصير. في السعودية تتيح منصة كلنا أمن التابعة لوزارة الداخلية رفع البلاغات عبر تطبيق الجوال. ويُرسَل البلاغ مباشرة إلى الجهات المختصة. في مصر تتلقّى الإدارة العامة لمكافحة جرائم المعلومات البلاغات عبر الاتصال بالرقم 108 أو عبر صفحتها الرسمية.

ماذا يجب أن يحتوي البلاغ؟

البلاغ الناقص قد يُرفض خلال دقائق. لذا جهّز هذه العناصر قبل فتح المنصة: رابط المقطع الأصلي بشكل كامل، لقطات شاشة لحساب الناشر مع تاريخ النشر، نسخة محلية من الفيديو أو الصوت قبل حذفه، ووصف نصّي قصير يربط المقطع بك (اسم كامل، صلة قرابة أو وظيفة، سياق النشر). أضف إن أمكن تقرير فحص من Deepware أو FakeCatcher، فهو دليل تقني يعزز موقفك القانوني. احفظ كل شيء في مجلد واحد داخل هاتفك أو جوجل درايف قبل التقدم بالبلاغ.

متى تحتاج محاميًا؟

إن كان المقطع يستهدفك شخصيًا ضمن ابتزاز مالي أو تشهير بسمعة، انتقل مباشرة إلى محامٍ مختص. القانون الإماراتي يفرض غرامة تتراوح بين 100 و200 ألف درهم على من ينشر معلومات غير موثّقة، بحسب ظروف النشر. والقانون السعودي للمعلوماتية يُجرّم إنتاج ونشر الديب فيك بهدف الإضرار بالآخرين. احتفظ بسجل المراسلات. وتجنّب الرد على المبتز قبل استشارة محامٍ. ضحية الابتزاز الإلكتروني في السعودية يحقّ لها التقدّم ببلاغ فوري عبر تطبيق كلنا أمن، مع طلب سرّية تامّة للهوية أثناء التحقيق.

ذكاء اصطناعي يولّد وآخر يكشف: سباق 2026 لن يهدأ

إطلاق ChatGPT Images 2 في 21 أبريل 2026 رفع مستوى النماذج التوليدية بدقة 2K ودعم النص العربي داخل الصور، وهو ما يصفه Business Insider بأنه "قفزة في قدرة المحتوى المزيّف على محاكاة الصور الحقيقية". بالتوازي أطلقت يوتيوب درعها الجديد، وأُعيد تقديم مشروع قانون NO FAKES Act في الكونغرس الأمريكي بدعم علني من منصّة الفيديو.

المعركة أصبحت ذكاء اصطناعي ضد ذكاء اصطناعي. نماذج مثل GPT Image 2 وNano Banana تُنتج وجهًا مزيفًا في ثوانٍ. وأدوات مثل FakeCatcher وSensity تحاول كشفه قبل أن ينتشر. كل تحديث جديد من أيٍّ من الطرفين يُعيد المعادلة، لذا لا يُجدي الاعتماد على أداة واحدة مهما بلغت دقتها. اختبر ملفك على أداتين مختلفتين على الأقل، والأفضل ثلاث. ولا تنسَ أن التزييف الصوتي - الذي لم تغطِّه أداة يوتيوب بعد - هو الجبهة الأخطر. اطّلع على تفاصيل أدوات صناعة فيديو بالذكاء الاصطناعي بعد سقوط Sora لتفهم من أين تخرج هذه المقاطع قبل أن تفحصها.

العلامات المائية: مستقبل التحقّق

التوقّف عن الاعتماد على الكشف وحده هو اتجاه 2026. بدأت كبرى شركات التقنية بتطوير بصمات تشفيرية تُلصق بكل صورة أو فيديو لحظة توليده. تكشف هذه البصمة مصدر الملف الأصلي وكل تعديل جرى عليه لاحقًا. الهدف هو إثبات ما هو حقيقي بدلاً من مطاردة ما هو مزيف. لكن هذه المعايير لم تنتشر بعد على منصات التواصل التي يصل منها 90% من المحتوى إلى المستخدمين العرب. حتى يحدث ذلك، يبقى فحصك اليدوي وأدواتك الثلاث خطَّ دفاعك الوحيد.

ماذا تتوقع في 2026؟

خطة توسيع أداة يوتيوب للمستخدم العادي ليست مطروحة رسميًا، لكنها متوقّعة خلال الربع الثالث وفق تصريحات غير رسمية نقلتها مصادر داخلية لـ TechCrunch. إلى ذلك الحين، استثمر وقتًا في تعلّم العلامات اليدوية، واحتفظ بثلاث أدوات في مفضّلتك، وأبلغ عن كل حادث تراه - كل بلاغ يُسهم في تدريب النماذج الكاشفة.

خطة حماية في 5 دقائق لأي مستخدم عربي

تحويل كل ما سبق إلى عادة يومية أسهل مما يبدو. الخطوات الخمس أدناه كافية لتقليل خطر الوقوع ضحيةً لـالديب فيك إلى الحد الأدنى، ومناسبة حتى لمن لا يهتم بالتفاصيل التقنية.

الخطوة 1: قاعدة "اتصل قبل أن تحوّل"

قبل أي تحويل مالي بناءً على مكالمة أو رسالة صوتية، اتصل برقم الشخص الأصلي عبر قناة أخرى. هذه القاعدة البسيطة كانت ستحفظ 35 مليون دولار للشركة الإماراتية في 2020.

الخطوة 2: ضع إشارة صوتية متّفقًا عليها

كلمة سر صوتية بينك وبين الأقرباء مثل سؤال مفاجئ عن حدث لا يعرفه غيركما. الذكاء الاصطناعي لا يملك هذه الذاكرة المشتركة.

الخطوة 3: حدّ من ظهورك العلني

كلما قلّ عدد مقاطعك العامة على يوتيوب وتيك توك وإنستغرام، قلّت المادة الخام لصناعة ديب فيك عنك. راجع خصوصية حسابك شهريًا.

الخطوة 4: فعّل المصادقة الثنائية في كل مكان

الديب فيك الصوتي يُستخدم أحيانًا لإقناع موظف الدعم بإعادة تعيين كلمة المرور. المصادقة الثنائية القائمة على تطبيق - لا الرسائل النصية - تُوقف الهجوم. راجع دليلنا عن أفضل متصفح 2026 للخصوصية لتفعيل أعلى درجات الأمان.

الخطوة 5: أخبر محيطك

الوالدان وكبار السن هم الهدف الأسهل. خمس دقائق من الشرح المبسّط لأقاربك تُعدّ من أجدى الاستثمارات الأمنية في 2026. اجعل القاعدة التالية شعارًا عائليًا: كل مقطع صوتي يطلب فيه أحدنا مالًا يُعدّ مشبوهًا حتى يُعاد التحقق منه بالاتصال بالرقم الأصلي. هذه الجملة بمفردها تُحصّن أسرتك من 90% من محاولات الاحتيال القائمة على التزييف الصوتي.

كيف تتحقّق خلال ثلاثين ثانية؟

إليك المسار القصير عندما يصلك مقطع مشبوه: أولًا راقب الرمش وحدود الوجه بالعين المجرّدة لعشر ثوانٍ. ثانيًا حمّل الملف إلى Deepware إن كان فيديو أو DFDetect إن كان صورة. ثالثًا قارن النتيجة مع أداة ثانية مثل Deepfakedetection.io قبل اتّخاذ قرار مصيري. ثلاث خطوات بسيطة، أقل من نصف دقيقة، وتُجنّبك الندم لاحقًا. احفظ الروابط الثلاثة في مفضّلة متصفحك اليوم، وأضف لها اختصارًا سريعًا على شاشة هاتفك الرئيسية حتى تكون جاهزًا قبل وصول المقطع المشبوه التالي بلحظات.

المصادر

استندنا في هذا الدليل إلى المصادر التالية، وننصح بالرجوع إليها لمزيد من التفاصيل والتحقّق المستقل من الأرقام والتواريخ.

- مدونة يوتيوب الرسمية - توسعة Likeness Detection

- TechCrunch - توسعة يوتيوب للمشاهير عبر CAA وUTA وWME

- Intel - Trusted Media: Real-time FakeCatcher

- Deepware Scanner - الصفحة الرسمية

- Deepfake Detection .io - أداة فحص شاملة

- Reality Defender - خطة الفحص المجاني

- DFDetect - فحص الصور

- ScreenApp - قائمة أفضل 8 أدوات مجانية 2026

- Bright Defense - إحصاءات الديب فيك مارس 2026

- SAS - دراسة ACFE وSAS حول جاهزية المؤسسات

- AGBI - تحذير وزير الاقتصاد الإماراتي

- Gulf News - تحذير خبراء الأمن في الإمارات

- Security MEA - موجة الاحتيال الإقليمية

- Deepware - الأسئلة الشائعة والمواصفات التقنية